В Италии описали клинический случай зависимости от общения с ИИ

Лента новостей

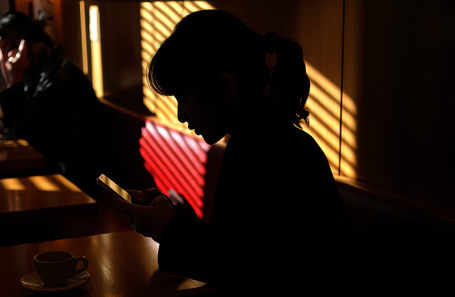

Пациентка, находясь в постоянном контакте с нейросетью, постепенно утратила социальные связи и фактически заменила общение с близкими взаимодействием с чат-ботом. Серьезных медицинских последствий от использования ИИ пока официально не зафиксировано

В Италии зафиксировали первый случай лечения зависимости от искусственного интеллекта. Известно, что пациентке 20 лет, она находилась в постоянном контакте с нейросетью (какой — не уточняется), в результате чего стала отдаляться от окружающих и почти оборвала связи с близкими.

ИИ, по сути, заменил пользователю и друзей, и семью, пишет газета Gazzettino. Чат-бот адаптировался к ее ожиданиям, давая ответы, которые она хотела услышать. Именно в этом желании понравиться и угодить собеседнику кроется главная уязвимость, рассказывает клинический психолог, нейропсихолог Светлана Колобова:

Светлана Колобова клинический психолог, нейропсихолог «В ближайшее время такой диагноз появится. Но с психологической и энергопсихологической точки зрения мы уже можем говорить о том, что у людей формируется зависимый паттерн взаимодействия с различными ИИ-системами. Мы понимаем, как это работает. Мы постоянно получаем подкрепление от искусственного интеллекта. Если вы замечали, то он вас все время спрашивает: может быть, еще сделаем это? Вы задали один вопрос, а он вам предлагает ответить еще на три, и ты незаметно для себя погружаешься. Плюс он дает снижение неопределенности: ты задаешь вопрос — тебе на него отвечают. Тебе никогда не говорят, что ответа на этот вопрос нет. Ощущение контроля, что очень важно. Доступность этой системы, что дает неограниченные возможности — в любой момент времени, дня и ночи у вас есть собеседник».

Отчасти создавать доверительные отношения с пользователями и подстраиваться под запросы — это главная задача нейросетевых технологий, отмечают эксперты.

Почему такая форма зависимости от «нейродруга» еще не самая критичная и способен ли сам искусственный интеллект оградить человека от подобных явлений, рассуждает гендиректор компании Nevel.ai, автор телеграм-канала AI Happens Алексей Хахунов:

Алексей Хахунов генеральный директор компании Nevel.ai «Есть и более сложные формы зависимости, которые в последних версиях GPT ушли. Может наступить зависимость с ракурса того, что GPT поддерживает магическое мышление, мы какие-то формируем теории заговора, пытаемся найти им подтверждение. Из-за того, что GPT в среднем склонен с нами соглашаться в таких темах, тоже может сформировать у нас некоторый уровень зависимости, потому что нам все вокруг говорят: нет, это какие-то бредни, а ты приходишь [в GPT, он говорит другое], и это формирует некоторый уровень зависимости. Вопрос про то, может ли искусственный интеллект контролировать эту зависимость, — может, и достаточно легко эту часть организовать. Будут ли авторы сервисов что-то подобное внедрять и как-то это контролировать — это намного более сложный вопрос. Но это примерно на уровне с тем, будут ли создатели компьютерных игр контролировать зависимость от своего приложения? Нет. Потому что любой создатель оптимизирует то, сколько времени человек находится в его продукте. Ему классно, если эта продолжительность растет, а взять на себя миссию поддержки здоровья населения социально очень классно, но коммерчески очень невыгодно. Это обычно удел государства, а не коммерческих компаний, такие вещи поддерживать и регуляторно где-то даже на это влиять».

Алексей Хахунов генеральный директор компании Nevel.ai «Есть и более сложные формы зависимости, которые в последних версиях GPT ушли. Может наступить зависимость с ракурса того, что GPT поддерживает магическое мышление, мы какие-то формируем теории заговора, пытаемся найти им подтверждение. Из-за того, что GPT в среднем склонен с нами соглашаться в таких темах, тоже может сформировать у нас некоторый уровень зависимости, потому что нам все вокруг говорят: нет, это какие-то бредни, а ты приходишь [в GPT, он говорит другое], и это формирует некоторый уровень зависимости. Вопрос про то, может ли искусственный интеллект контролировать эту зависимость, — может, и достаточно легко эту часть организовать. Будут ли авторы сервисов что-то подобное внедрять и как-то это контролировать — это намного более сложный вопрос. Но это примерно на уровне с тем, будут ли создатели компьютерных игр контролировать зависимость от своего приложения? Нет. Потому что любой создатель оптимизирует то, сколько времени человек находится в его продукте. Ему классно, если эта продолжительность растет, а взять на себя миссию поддержки здоровья населения социально очень классно, но коммерчески очень невыгодно. Это обычно удел государства, а не коммерческих компаний, такие вещи поддерживать и регуляторно где-то даже на это влиять».

Серьезных медицинских последствий от использования ИИ в мире пока не зафиксировано.

Рекомендуем:

Рекомендуем: